Prima notizia: due esperti di sicurezza informatica americani qualche giorno fa riescono ad hackerare una Jeep Cherokee con connessioni di ultima generazione, sfruttando una falla della sua rete Wi-Fi. I due hacker sono stati in grado non solo di intervenire a distanza sull’aria condizionata, la radio e il display digitale della vettura, ma anche di disattivare il sistema di trasmissione dai pedali al motore, cosicché, nel bel mezzo di un sorpasso, il giornalista di Wired alla guida ha visto la sua auto perdere velocità fino ad arrestarsi del tutto, nonostante cercasse di premere sull’acceleratore a tavoletta. In circostanze diverse, se non si fosse trattato di un test, sarebbe finita male: potevano essere disattivati i freni, per esempio, o lo sterzo, cosicché il conducente sarebbe andato a schiantarsi dopo poche centinaia di metri. Subito dopo la notizia, Fiat-Chrysler Automobiles ha prima rilasciato un aggiornamento software per correggere il bug, poi ha richiamato in officina 1,4 milioni di autovetture per cambiare il sistema informatico di bordo.

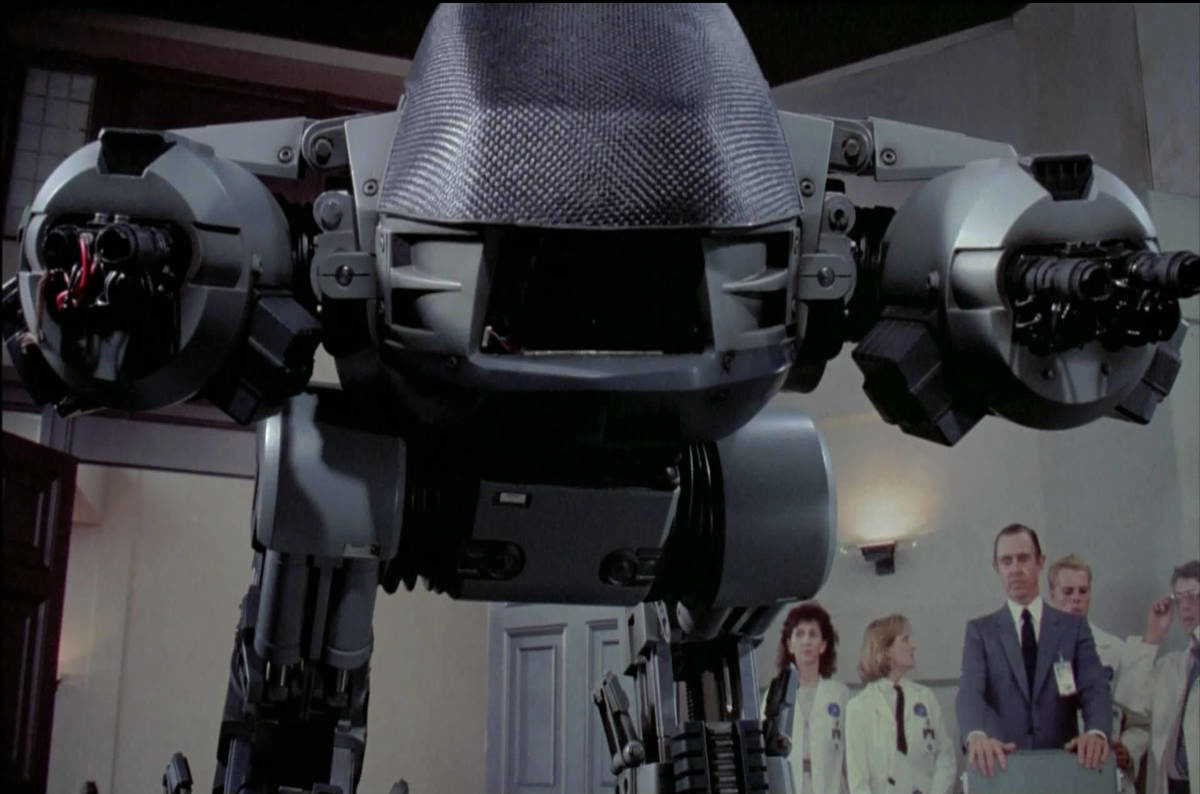

Seconda notizia: il 1° luglio scorso un operaio di una ditta di manutenzione delle catene di montaggio di una fabbrica Volkswagen a Baunatal, in Germania, viene ucciso da uno dei bracci meccanici su cui stava lavorando. I giornali hanno subito gradito al primo assassinio al mondo perpetrato da un robot. L’operaio, 22 anni, stava compiendo le sue attività all’interno di un’area rossa, ossia lo spazio di movimento della macchina, quando questa si è messa in moto e ha schiacciato il giovane contro una lastra.

Terza notizia: un uomo di cinquant’anni con problemi coniugali ha fabbricato, in casa propria, una pistola perfettamente funzionante – una calibro 33 – grazie alla sua stampante 3D e ha ucciso, con cinque colpi, la moglie e il figlio di due anni. Poi si è suicidato gettandosi dal balcone di casa dopo che la pistola ha smesso di funzionare.

L’ultima notizia è falsa, ma potrebbe naturalmente essere vera. È ormai da circa due anni che circolano on-line software gratuiti attraverso i quali è possibile fabbricare una pistola con una stampante 3D alla portata di tutti. Non sono armi molto sofisticate, si inceppano, a volte richiedono di essere ricaricate dopo un solo colpo, ma il fatto è che per averne una bastano una stampante da poche centinaia di euro, un po’ di materiale e una connessione a Internet. Niente porto d’armi.

Queste tre notizie sono di quelle che, diffuse con allarmismo dai media, spingono l’opinione pubblica a interrogarsi sui rischi della tecnologia, promuovendo spesso una paura irrazionale nei confronti dell’automazione e convincendo a volte gli stessi politici a intervenire con legislazioni proibizionistiche per mettere un freno al fenomeno. Il rischio è che un giorno, se casi del genere si diffondessero, potremo vedere le automobili wi-fi o le macchine senza conducente (self-driving cars chiamate anche autonomous vehicles), i robot da compagnia o le stampanti 3D ritirate dal mercato. Non è certo uno scenario auspicabile. Ma questi casi ci spingono a lanciare l’allarme sull’esigenza inderogabile di regolamentare e rendere più sicure le nuove tecnologie prodotte dall’industria dell’automazione, che promettono presto di essere pervasive. L’Internet of Things, ossia la rete che connetterà tra loro non più solo i PC ma anche tutti gli oggetti elettronici possibili (inclusa l’automobile) con il nostro smartphone, ha un serio problema di sicurezza informatica. Le self-driving cars non sono ancora state regolamentate, benché Google, Audi, Mercedes-Benz, Nissan e Tesla le vogliano immettere sul mercato entro un paio d’anni. Non c’è una norma che impedisca di stampare una pistola a casa se non si detiene un regolare porto d’armi. E non c’è al momento nessuna regolamentazione sui robot militari di cui gli eserciti di tutto il mondo si stanno velocemente dotando, sull’onda del successo dei droni da combattimento.

La fantascienza ci ha messo sull’avviso da anni. Pensiamo ai tanti romanzi e film sull’intelligenza artificiale “cattiva”. Non una buona pubblicità per chi da decenni cerca di realizzare sistemi intelligenti autocoscienti (le cosiddette AI forti); ma personaggi come Stephen Hawking o Elon Musk si sono preoccupati così tanto della prospettiva di una intelligenza artificiale autocosciente, da suggerire che potrebbe rivelarsi l’ultima invenzione dell’umanità. Lo stesso Musk ha donato 10 milioni di dollari di recente al Future of Life Institute, un think-tank fondato dal fisico Max Tegmark a Boston, per studiare il modo di rendere più sicure le AI ed evitare lo scenario Terminator. In un racconto del 1953, Sally, Isaac Asimov immaginava già le auto guidate da computer e non da esseri umani, e i rischi connessi. Una versione più moderna dello stesso tema, aggiornata agli sviluppi recenti, è Vecchia vernice, una storia scritta da Megan Lindholm inclusa nell’antologia The Year’s Best Science-Fiction del 2012. Nel suo ultimo film, Chappie (in Italia uscito con il titolo Humandroid), il regista sudafricano Neill Blomkamp ci ha messo in guardia dallo sviluppo incontrollato di robot militari, nel film impiegati anche per la sicurezza delle città: un virus inserito attraverso una chiavetta USB può permettere a un malintenzionato di assumere il controllo dei robot.

Se continuiamo a lasciare agli scrittori e ai registi di fantascienza il compito di immaginare i rischi futuri connessi all’automazione incontrollata, passeremo molti guai. Al momento la situazione è ancora sotto controllo: per Jim Smith, che si occupa di sicurezza delle reti Internet per la compagnia Ixia, il caso degli hacker della Jeep Cherokee non è allarmante, ma – spiega su Popular Science – potrebbe diventare un serio problema da qui a tre-quattro anni, con lo sviluppo delle autovetture connesse. Il direttore dell’Istituto Italiano di Tecnologia, Roberto Cingolani, ha chiarito che l’incidente dell’operaio tedesco è un caso isolato che non ha nulla a che vedere con il rischio di una “rivolta delle macchine”, ma ha ricordato la necessità di una regolamentazione dei robot futuri. Non si tratta solo della vecchia storia delle “tre leggi della robotica” inventate da Asimov, che impedivano ai robot positronici di danneggiare gli esseri umani: “Ad esempio stabiliremo che un’auto senza conducente dovrà rispettare limiti di velocità più stringenti e distanze più ampie, e poi costruiremo sistemi ridondati, in modo che in caso di guasti ci siano soluzioni di riserva”, spiega Cingolani su La Stampa. “Sarà comunque necessario un pulsante che ridia agli umani il controllo”.

L’Italia in questo settore è all’avanguardia: un anno fa i ricercatori del progetto RoboLaw, coordinato da Erica Palmerini, docente di diritto privato alla Scuola Superiore Sant’Anna di Pisa, hanno presentato alla Commissione e al Parlamento europeo un primo studio sulla necessità di sviluppare un “diritto della robotica”, una nuova branca che regoli i casi in cui sistemi automatici finiscano per danneggiare gli esseri umani, introducendo anche normative per minimizzare questi rischi. Il rapporto, intitolato Guidelines on Regulating Robotics, analizza i problemi normativi, etici e legali di quattro tipologie di robot: le auto senza conducente, i robot-chirurgo, le protesi robotiche e i robot da compagnia (su cui numerose compagnie e centri di ricerca stanno lavorando con impegno). Tocca ora all’Unione europea recepire questi indirizzi e iniziare a produrre una legislazione in merito. Gli Stati Uniti sono già molto avanti nell’adozione di leggi per la regolamentazione delle auto senza conducente: diversi stati, tra cui California e Florida, hanno già una legislazione in materia, e molti altri ne stanno discutendo all’interno dei parlamenti statali. A livello federale, da circa due anni la National Highway Traffic Safety Administration, che si occupa della sicurezza delle autostrade americane, sta studiando il problema per capire quali norme adottare. Una proibizione dell’utilizzo delle auto senza conducente è da escludere, dato che tutte le analisi dimostrano il loro positivo impatto sulla riduzione del numero di incidenti.

Le preoccupazioni maggiori provengono dallo sviluppo dei robot militari (detti anche autonomous weapons). Il dibattito internazionale è sbarcato alla fine di maggio sulla rivista Nature, dove, in un editoriale, l’esperto di intelligenza artificiale Stuart Rusell dell’Università della California a Berkeley ha definito i robot militari “la terza rivoluzione della guerra, dopo la polvere da sparo e le armi nucleari”. Danni cosiddetti ‘collaterali’ prodotti dai droni militari sono ormai ben noti e tristemente diffusi. La DARPA, l’agenzia del Dipartimento della Difesa USA che lavora sulla ricerca di frontiera, sta sviluppando ulteriormente le capacità dei droni, con progetti in grado, per esempio, di renderli autonomi al punto da creare “squadre” di robot per distruggere obiettivi più complessi, sfruttando l’intelligenza collettiva. Ma è solo l’inizio. Robot militari sempre più sofisticati e indipendenti dal controllo umano rappresentano l’ultima frontiera dell’industria bellica, perché permettono di minimizzare le vittime umane tra i soldati, il cui alto numero può portare l’opinione pubblica di un paese a costringere un governo a ritirare le proprie forze da un teatro di guerra. Le Nazioni Unite stanno portando avanti da alcuni anni audizioni con esperti internazionali al fine di arrivare a un trattato che metta al bando i robot militari, ma molto difficilmente paesi come Stati Uniti, Cina o Regno Unito, che stanno lavorando in questo settore e che siedono al Consiglio di sicurezza dell’ONU, accetteranno un tale accordo. Il prossimo 27 luglio sarà resa pubblica una lettera aperta, firmata da migliaia di scienziati, ricercatori e professionisti nel settore dell’intelligenza artificiale, della robotica e delle tematiche sociali ad esse connesse, per chiedere una moratoria internazionale allo sviluppo dei robot militari. Avrà effetto? Si vedrà. Intanto è importante porre la questione all’attenzione mondiale.

Si potrebbe pensare che si tratti di scenari molto distanti dalla nostra quotidianità. Non è così. Il principio che sottende i diversi casi citati – veicoli automatici, robot militari, automobili connesse – è lo stesso: una mancanza di sicurezza nello sviluppo dei nuovi sistemi di automazione. Con la crescita che sta vivendo il settore dell’Internet of Things, il problema sbarcherà presto nelle nostre case. Forse è fantascienza immaginare che il nostro robot casalingo che pulisce il pavimento possa essere hackerato al punto da scagliarsi contro di noi e ucciderci, ma mutatis mutandis rischieremo di dover affrontare molti problemi legati alle falle della sicurezza delle reti domestiche e di quelle delle smart city. Si stima che nel 2020 i dispositivi connessi tra loro saranno 26 miliardi, senza contare i tradizionali PC, tablet o smartphone. Le auto che si collegano in Wi-Fi per scaricare aggiornamenti, permetterci di ascoltare musica su Spotify direttamente dallo stereo o controllare Google Maps mentre stiamo alla guida sono solo la punta dell’iceberg. Certo poco importa se un hacker riesce ad assumere il controllo del nostro frigorifero per scoprire che al suo interno c’è una mozzarella ormai scaduta, o se consumiamo alcolici, o quale marca di maionese prediligiamo. Ma già oggi, se abbiamo una stampante connessa tramite Wi-Fi, è possibile con un programma spiare i documenti che vengono stampati. Il termostato che regola il nostro sistema di riscaldamento potrebbe essere hackerato e portato a 100° C, se connesso alla rete, come oggi avviene sempre più spesso (app sviluppate ad hoc ci consentono di regolarlo prima del nostro arrivo a casa).

Aumentiamo il livello di rischio. Una Internet of Things estesa a un’intera città può risolvere parecchi problemi – dal traffico all’ottimizzazione della distribuzione di energia elettrica e di acqua potabile – ma può essere vulnerabile ad attacchi informatici. E avere una rete elettrica che un buon hacker è in grado di mandare giù in pochi attimi, con danni economici incalcolabili, non è una bella prospettiva (situazioni del genere, com’è noto, si sono già verificate). Il cyberwerfare, la guerra cibernetica, può arrivare a manomettere i segnali dei satelliti, mandare in tilt i sistemi di guida di un aereo, disattivare i sistemi di sicurezza di una centrale nucleare. Investire sulla sicurezza di queste reti è un imperativo. È vero che qualsiasi gruppo di hacker abbastanza capace troverà una falla nel sistema e la sfrutterà per violarlo. Ma non è detto che debba essere sempre così. Sistemi di crittografia quantistica hanno già dimostrato la loro robustezza rispetto a quelli digitali tradizionali. L’evoluzione delle comunicazioni quantistiche potrebbe essere la soluzione: estendendola a tutta la rete Internet del mondo, potrebbe forse creare una rete a prova di hacker. La sua robustezza dipende infatti, com’è noto, da una peculiarità della fisica: manomettere un sistema quantistico comporta la sua automatica distruzione.

Con l’aumentare della complessità della nostra società, il ricorso all’automazione diventerà inevitabile. Sistemi complessi richiedono soluzioni sempre più complesse per la loro gestione. Non potremo farne a meno. Il rischio è quello di lasciare che la tecnologia diventi pervasiva prima che si siano prese tutte le precauzioni per gestirla: normative, leggi, regolamentazioni, sistemi di sicurezza inviolabili sono necessari per impedire che il dominio della lotta si estenda a tutta la nostra rete Internet e agli strumenti ad essa collegati (oggi i PC, domani le automobili, dopodomani chissà); ma anche per impedire che l’evoluzione tecnologica porti nuovi problemi invece che nuove soluzioni: i robot militari, per esempio, sono un rischio troppo grande da correre. Andrebbero messi al bando quanto prima. A un primo sguardo, un drone che sgancia una bomba e il termostato di casa nostra sembrano non avere nulla in comune. In realtà sono parenti stretti: sono sistemi automatici, macchine, robot che promettono di diventare sempre più autonomi dal nostro controllo, perché siamo noi a volerlo. Prima di farlo, tuttavia, è bene preventivare ogni possibile rischio e anticiparlo prima che diventi un problema troppo grande per risolverlo.

Oggi i sistemi sviluppati da Google sono gi in grado di guidare su auto Fca, le elettriche Tesla di Elon Musk hanno nel software l autopilota gi pronto, Nissan ha portato negli scorsi giorni una flotta di Leaf autonome a girare per le strade di Londra.